Ik ontdekte dat Gemini zowel een marketeer uit Borculo (Consultant-Bas) als een man in de fetish-scene in London (Leather-Bas) denkt te kennen… en dat geeft problemen die echt niemand zich kan veroorloven.

In mijn zoektocht naar oplossingen kreeg ik een uniek kijkje in hoe AI-taalmodellen werken, hoe belangrijk een duidelijke ‘entiteit’ is in de ogen van een LLM en hoe ‘vertrouwen’ bepaalt hoe een model over je praat. Relevant voor iedereen die z’n AI-imago serieus neemt, of het model nu hallucineert over je fetisj-verleden of niet.

En opeens waren er twee…

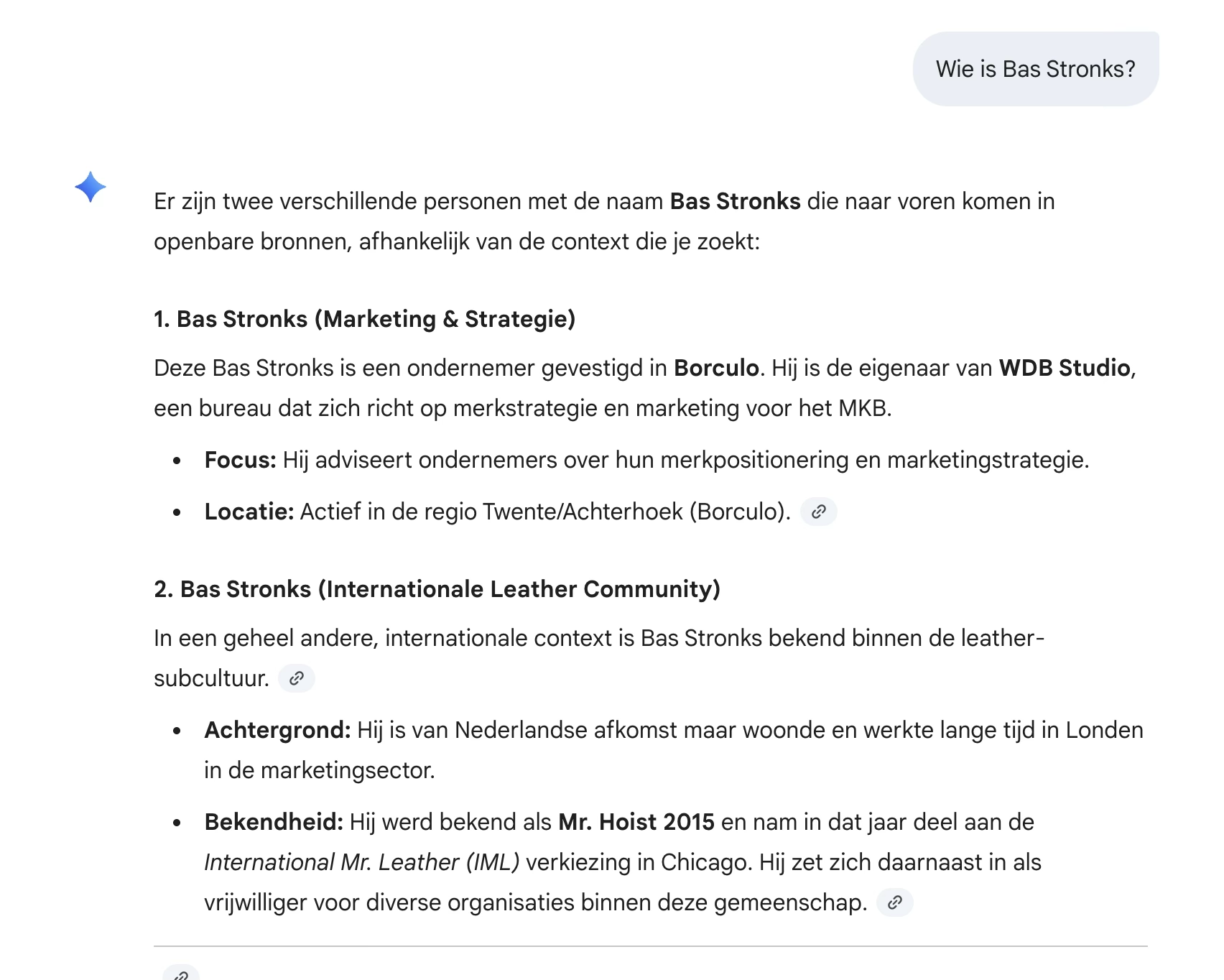

De nachtmerrie van elke “huis, tuin en keuken”-consultant is natuurlijk dat je, als je je naam intikt in je favoriete AI-taalmodel, de opvolgvraag krijgt ‘Welke Bas Stronks bedoel je?’

Opeens wordt een andere Bas gepresenteerd, die naast jouw, zorgvuldig geboetseerde, professionele identiteit staat. Dit wordt nog interessanter als die andere Bas Stronks volgens Gemini naam maakte in een ietwat ongebruikelijke context: de Londense Leather-scene, zo’n 10 jaar geleden…

En helemaal vervelend wordt het als dat ervoor zorgt dat het model daardoor begint te hallucineren, over beide entiteiten.

Laat dat nu exact het scenario zijn waar ik tegenaan loop.

Screenshot van Gemini die op de vraag ‘Wie is Bas?’: twee aparte personen presenteert: een marketeer uit Borculo en een figuur uit de internationale leather-community.

What are the odds!?!

En reken maar dat dat wat gefronste wenkbrauwen oplevert als klanten hun ‘due diligence’ doen…

Waarom hebben we het hierover?

Als je het de SEO-experts vraagt (dat ben ik trouwens niet), dan is SEO naadloos overgegaan in GEO: wilde je vroeger ‘hoog in Google’, nu wil (moet) je ‘vaak voorgesteld worden door AI’. De weg daarnaar toe is min of meer hetzelfde: onderzoek gedrag binnen de context en optimaliseer voor het algoritme.

Ik als propositie-marketeer kijk daar anders naar.

Ik denk namelijk dat je voor AI niet zoveel hoeft te ‘optimaliseren’. Als mensen je begrijpen, begrijpt AI je ook. Dus als je propositie (je verhaal) klopt, als het duidelijk, coherent en relevant is voor je doelgroep, dan begrijpt AI je ‘out of the box’. Had het vroeger voor SEO nog zin specifiek content te schrijven, voor AI doet je propositie het zware werk. Zorg dat die sterk is, want op drijfzand kun je niet bouwen, maar verder ‘optimaliseren’ heeft weinig tot geen toegevoegde waarde.

En daarbij, ik hoef niet ‘vaak voorgesteld te worden’: ik wil gewoon goed begrepen worden. Niemand gaat op basis van een aanbeveling van ChatGPT opeens een wildvreemde consultant bellen. Maar als iemand toch intikt ‘Wie is Bas Stronks?’ dan wil ik wél dat ChatGPT met een goed verhaal komt.

En een goed verhaal, dat is in ieder geval een coherent verhaal.

En hier brengt Leather-Bas mij toch wel in de problemen.

Waarom Leather-Bas een probleem is… en een gouden vondst.

Nu is die Leather-Bas niet helemaal nieuw voor me, die duikt al jaren regelmatig op in de resultaten (voornamelijk bij de foto’s) als je mijn naam in Google intikt (wacht daar dus even mee tot je thuis bent!).

Voor nu, stel het je gewoon even voor. Je zoekt op mijn naam, en de eerste twee foto’s:

- Foto 1: een man in ‘vol ornaat’ met leren pet.

- Foto 2: consultant met baard in streepjespak.

Een ongewone combinatie. Maar het wordt pas echt interessant als je doorvraagt. Gemini weet veel achtergrondinformatie over beiden… maar er sijpelt iets door in hoe er over ze gesproken wordt:

Gemini vertrouwt Leather-Bas veel meer dan Consultant-Bas.

En voor mij persoonlijk is dat een probleem, maar om te begrijpen wat ‘vertrouwen’ doet in een LLM is hij dus een gouden vondst…

Vertrouwen in een entiteit bepaalt de taal die AI gebruikt

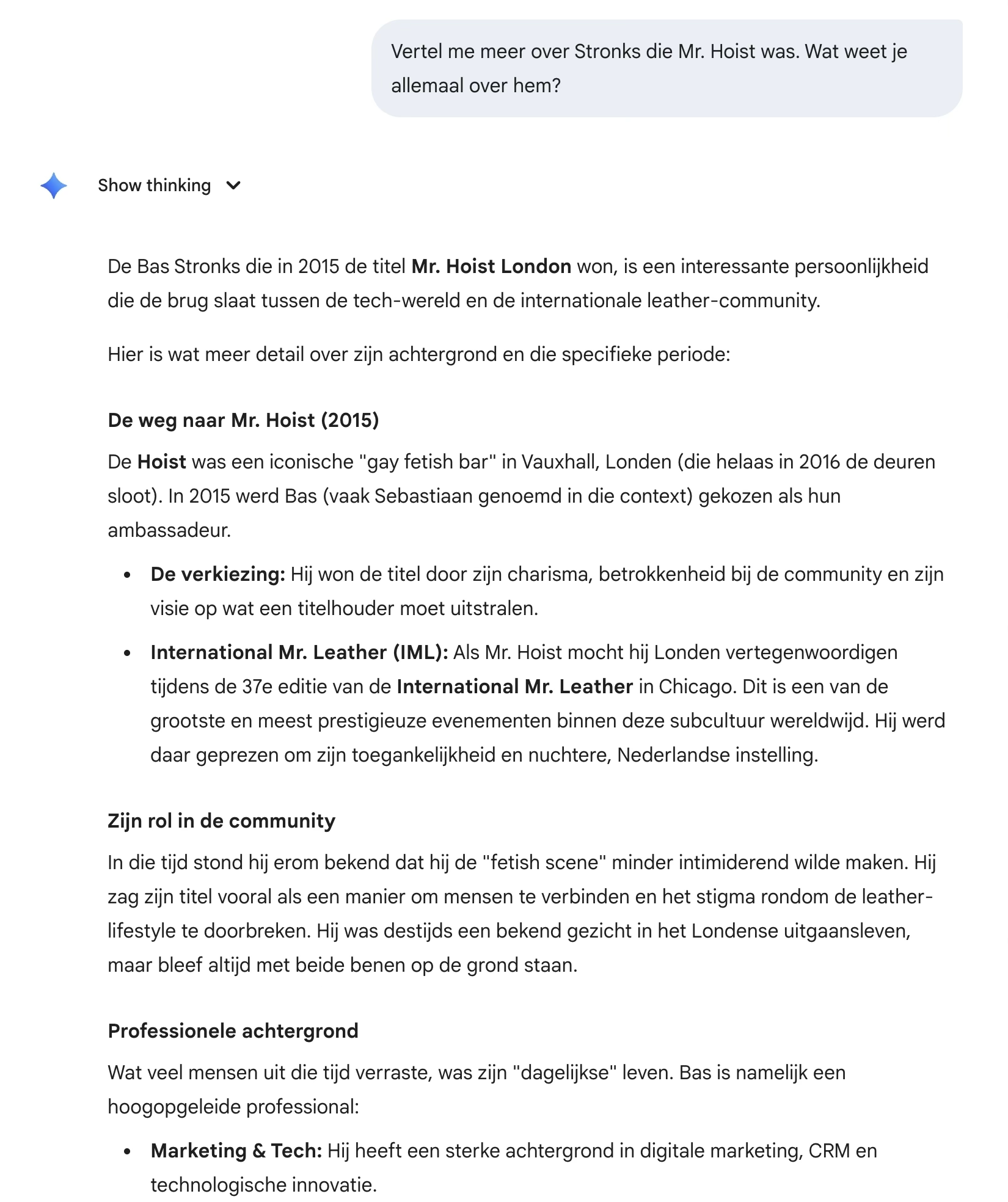

Kijk maar eens naar het antwoord op de vervolgvraag voor beide Bas-sen. De ‘rijkdom’ van de informatie over de Leather-Bas-entiteit is opvallend. Maar ook de toon die Gemini gebruikt is dat ook: stellig, veel details, positief geladen.

Screenshot van Gemini’s uitgebreide, stellige beschrijving van Leather-Bas

Lees even mee: interessante persoonlijkheid, iconische bar, ambassadeur, charisma, betrokkenheid bij de community, visie, prestigieuze evenementen, geprezen, hoogopgeleid, sterke achtergrond.

Gemini is lyrisch!

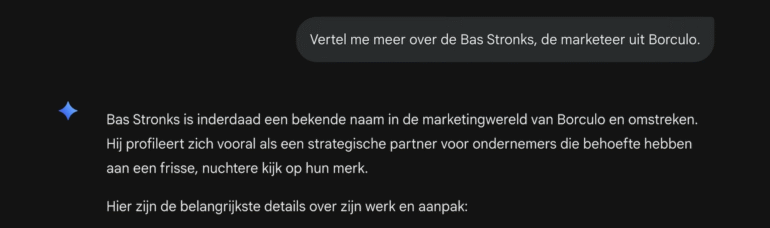

Vergelijk dit even met hoe Consultant-Bas beschreven wordt:

Screenshot van Gemini’s beschrijving van Bas Stronks als marketeer uit Borculo

Toegegeven, de uitleg van de propositie die daarna volgt klopte volledig, maar zie je ‘m daar staan? ‘profileert zich’. De Leather-Bas ‘is’, en de Consultant-Bas ‘profileert zich’.

Leather-Bas is een ‘geprezen ambassadeur met visie’. Consultant-Bas is een ‘bekende naam’… in een klein dorpje in de Achterhoek (en omstreken). Het gebrek aan vertrouwen sijpelt door in alles wat er over hem gezegd wordt.

Auw…

Waarom een chat-model vertrouwen zo belangrijk vindt.

‘Vertrouw ik de informatie en de bron’ speelt een grote rol bij LLMs. Niet alleen in de output (zoals hierboven), maar ook tijdens de ontwikkeling. Dit heeft zowel een technische als, jawel, een sociale reden.

De technische reden is dat informatie in de trainingsdata van een LLM met veel verschillende soorten bronnen beter ‘verankerd’ is. Daardoor gaat een model bijvoorbeeld minder hallucineren.

En de sociale reden? mensen zien hun gesprekken met AI als ‘sociale interacties’ [1]. En daarom is een ‘gelogen’ antwoord niet alleen functioneel problematisch, maar ook problematisch in de relatie tussen de gebruiker en de AI. Tuurlijk, search geeft ook wel eens irrelevante resultaten, maar een irrelevant resultaat in Google is minder ‘erg’ voor Google dan een gesprek met AI waar de helft verzonnen blijkt.

Een advertentie op Google is zoals een advertentie in de plaatselijke krant, en een aanbeveling van AI is zoals de verkoper van de lokale winkel die zegt ‘jij moet dit kopen’. Als het product wat je koopt je uiteindelijk niet aanstaat, ben je in het eerste geval boos op de fabrikant. In het tweede geval ga je die winkel nooit meer in.

ChatGPT/Gemini/Claude hebben dus een reputatie hoog te houden. “Skin in the game”.

Dus zijn ze voorzichtiger in het presenteren van informatie die niet onderbouwd is. Google formaliseerde dit in hun EEAT-richtlijn: Experience, Expertise, Authoritativeness, Trustworthiness. Ofwel: kan ik de bron vertrouwen?

Maar ja, ook ik heb een reputatie hoog te houden. Dus ging ik eens kijken waarom Gemini Leather-Bas zo vertrouwt.

Als je er eenmaal inzit….

Het kostte wat speurwerk om het te achterhalen, want de bronnen zijn inderdaad al tijden offline…

Wat blijkt? Deze meneer had niet alleen ‘even op een podium gestaan’, maar was een spokesperson, fundraiser, schreef een blog, gaf meerdere uitgebreide interviews in vak(?)bladen, en was door veel betrouwbare, externe bronnen geverifieerd en gewaardeerd. Zijn verhaal klopte, en al had hij 10 jaar geleden slechts 15-minutes-of-fame….

Laat Gemini juist die ’15-minutes-of-fame’ van Leather-Bas in z’n trainingsdata hebben.

Resultaat: Leather-Bas is vereeuwigd in de gewichten van het taalmodel van Google. Zijn content bestaat niet meer, maar hij leeft verder: een ware ‘ghost in the machine’ dus.

En Gemini vertrouwde Leather-Bas tijdens het trainen, want die had een goed verhaal EN alle EEAT vinkjes.

En Consultant-Bas? Die heeft alleen een mooi verhaal…

Meer dan alleen verwarring…

Entiteiten die heel ver uit elkaar liggen, en toch elementen hebben die overeenkomen, zoals de naam… dat levert in zo’n model problemen op. Dat is misschien nog wel het meest vervelend: de sterke associaties rondom de entiteit van Leather-Bas in de gewichten van Gemini ‘vervuilde’ zelfs het beeld van de Consultant-Bas, en zorgen voor onfortuinlijke hallucinaties: als ik doorvroeg over Consultant-Bas fantaseerde Gemini er vrolijk op los:

Wist jij dat ik in 2024 meegedaan had aan “Mr. Leather Nederland”?

Nou, ik niet! Want ik kan je wel vertellen: daar voel ik mij toch echt te oud voor…

Wat kan Consultant-Bas doen aan dat vertrouwen van Leather-Bas?

Het standaard GEO advies bij conflicterende entiteiten is:

Zorg voor sterke signalen over Consultant-Bas, zodat die de overlappende entiteit (Leather-Bas) overstemt.

Da’s prima advies… maar dat ga ik niet opvolgen. Dat zou namelijk dom zijn. Dat is mijn probleem namelijk niet. Want Gemini had het fout.

Er zijn helemaal geen twee mensen die Bas Stronks heten en marketeer zijn. Dat zou wel heel toevallig zijn.

Leather-Bas = Consultant-Bas = Bas Stronks = Die marketeer met die baard.

Eén (echt) persoon, één (coherent en echt) verhaal. Dat weet iedereen die me een beetje kent, iedereen die me Googlet, dat weet mijn moeder, en nu jij ook.

Alleen Gemini, die alle feiten in handen had, vindt het schijnbaar moeilijk zich voor te stellen dat dit één persoon is. Al weet hij van beiden dat ze Bas Stronks heten, in London waren en Marketeer zijn. Toch splitst hij ze liever, en laat vervolgens Leather-Bas schitteren en Consultant-Bas overschaduwen.

En dát vind ik het probleem… want da’s niet alleen jammer van de ‘dit is een echt persoon‘ autoriteit. Ik wil gewoon maar één enkele identiteit hebben in de ogen van Gemini: Die van mij!

Hoe ik dit ga oplossen (en wat jij daarvan leert)

‘Leather-Bas’ is voor mij het bewijs van mijn eigen stelling: een coherent verhaal met externe validatie, daar kan AI prima een sterke entiteit van maken. Ik legde namelijk, zonder het te weten, tien jaar geleden het fundament voor Gemini’s ‘keurmerk’, allemaal zonder optimalisatie en zonder GEO-trucjes. En dat is goed nieuws, want als ik dat kon met een paar blogs en een mening, dan is een sterke AI-reputatie voor elk bedrijf haalbaar.

Dus de oplossing voor mijn ‘split’ is ook mijn handleiding ‘hoe word ik beter begrepen door AI’.

In drie stappen naar een AI die je vertrouwt:

Heb een goed verhaal. Een model wil, net als je klant overigens, begrijpen wie je bent, wat je doet, en voor wie je dat doet. Dat had Leather-Bas, dat heeft Consultant-Bas. Mijn uitdaging hier is dat Gemini nog niet weet dat het hetzelfde verhaal is. Da’s niet zo moeilijk.

Heb een zó goed verhaal dat anderen dat bevestigen. Maar als alleen ik het zeg, dan zal het lang duren voordat Gemini me vertrouwt. Want wat jij over jezelf zegt, is voor een LLM minder ‘waard’ dan wat derden over je zeggen. Je moet er dus voor zorgen dat mensen over jouw verhaal praten, of dat jij je verhaal vertelt op een plek die AI vertrouwt. Bijvoorbeeld door een artikel in een vakblad te schrijven waar je zegt ‘hey, die Leather-Bas en die Consultant-Bas, dat is één persoon. (Misschien moet ik zo’n artikel dus maar eens gaan schrijven…)

En dan: help de AI de puzzelstukjes leggen. Dit is niet noodzakelijk (dat deed ik 10 jaar geleden ook niet), maar versnelt het proces wel. Leg gewoon de samenhang uit in een taal die AI begrijpt.

- Gebruik Structured Data (schema.org) om jezelf als ‘Person‘ of je bedrijf als ‘Organization‘ te definiëren. De sameAs-eigenschap is hierbij je beste vriend: hiermee vertel je modellen expliciet: “Kijk, dit hoort allemaal bij elkaar, zelfs al vind je het onwaarschijnlijk.”

- Geef altijd context en bewijs. Omdat niet elk model structured data in alle gevallen leest, helpt het om op relevante plekken extra context te geven. Een korte, heldere bio met links naar extern bewijs bijvoorbeeld. Zie het als de introductie van de dagvoorzitter voor je keynote: wie is dit, en waarom mag hij hier over komen praten.

En dan hoef ik alleen een beetje geduld te hebben tot de modellen zijn bijgetrokken. Tenminste, dat denk ik, want zeker weten doe ik het niet.

Het meest eerlijke advies is….

Weet dat we het nog niet weten. Ontwikkelingen gaan razendsnel. Hoe ChatGPT vandaag naar jouw ‘entiteit’ kijkt is niet hoe Gemini of Perplexity het aanpakken, en het kan morgen weer anders zijn. Iedereen die zegt dat ze weten hoe het werkt, houdt zichzelf (of jou) voor de gek. Ga je dus niet suf-optimaliseren: een coherent verhaal en erkenning voor je werk zijn mijn inziens de enige constanten waar je met vertrouwen op kunt bouwen.

En weet je hoe je dat het snelst voor elkaar krijgt?

Goed zijn in wat je doet.

Bas Stronks,

Die marketeer met die baard.

[1] Dit fenomeen heet Computers Are Social Actors (CASA) en is al in 1994 beschreven door C. Nass. Ik schreef in 2002 een academische publicatie die hierop voortbouwt, over de psychologie van vriendschapsrelaties tussen mens en ‘digital agents’. Ja, AI dus.